9月5日,腾讯宣布推出新一代大模型“混元Turbo”,相比前代模型,腾讯混元Turbo性能有显著提升,训练效率提升108%,推理效率提升 100%,推理成本降低 50%,解码速度提升 20%,效果在多个基准测试上对标GPT-4o,第三方测评居国内第一。

在腾讯全球数字生态大会上,腾讯公司副总裁、云与智慧产业事业群COO兼腾讯云总裁邱跃鹏宣布,腾讯混元Turbo在腾讯云上线,输入和输出价格只有前代模型的一半,企业和开发者可以直接在云上接入使用。

目前,腾讯混元在腾讯云上提供了多种尺寸的模型服务,通过API、专属模型、精调模型等接入和使用方式面向企业及个人开发者全量开放。腾讯混元在云上提供了Turbo、Pro、Standard、Lite等多个版本;在专属模型上开放了代码生成、角色扮演、Functioncall等;企业也可以通过腾讯云TI平台对腾讯混元进行精调。

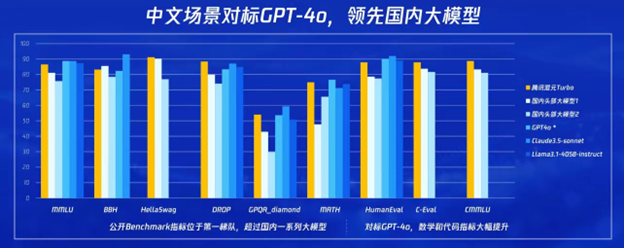

(图:公开benchmark测评腾讯混元Turbo与国内外大模型对比)

从去年开始,腾讯混元在国内率先采用MoE结构,并在这一技术路线上持续升级,通过自研的万亿级层间异构MoE结构,在模型不同层采用不同的专家个数和不同的激活参数量,同时优化训练数据,使得新一代模型混元Turbo在效果和性能上均实现大幅度的提升。

在业界公认的benchmark指标上,腾讯混元Turbo处于国内行业领先地位,效果接近国外头部模型GPT4o和Claude3.5。作为新一代旗舰大模型,腾讯混元Turbo在语言理解、文本创作、数学和代码等领域都有较大提升,跟前代模型相比,复杂数学解决能力提升38%,代码能力提升32%。

(图:公开benchmark测评腾讯混元Turbo与国内外大模型对比)

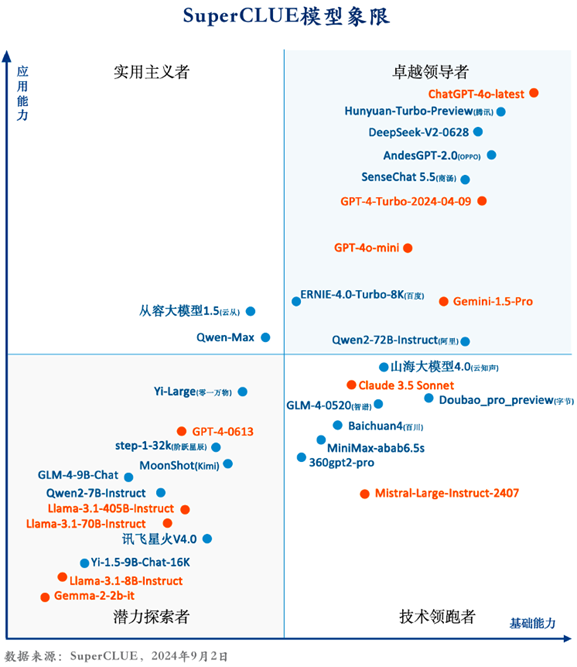

9月2日,中文大模型测评基准SuperCLUE发布《中文大模型基准测评2024年8月报告》,腾讯混元Turbo凭借在多个核心任务上的出色表现,总得分居国内大模型第一名。作为国内成绩最好的模型,腾讯混元Turbo在理科、文科均居于第一名。在围绕复杂任务和高阶推理的Hard任务上,腾讯混元Turbo表现出色,取得74.33分,是国内唯一超过70分的大模型,仅与ChatGPT-4o有微小差距。

作为腾讯全链路自研的大模型,自2023年9月正式亮相以来,腾讯混元通过持续的迭代和实践,积累了从底层算力到机器学习平台再到上层应用的自主技术,其行业领先技术实力获多方认可,在中国电子学会2023科学技术奖评选中,腾讯混元《面向大规模数据的Angel机器学习平台关键技术及应用》获科技进步一等奖。

基于领先的模型能力积累,腾讯混元大模型正在积极推进内部应用落地,让大模型创造更多价值,目前腾讯内部近700个业务及场景已接入,包含腾讯元宝、腾讯云、QQ、微信读书、腾讯新闻、腾讯客服等。此前,腾讯旗下协作SaaS(软件即服务)产品全面接入腾讯混元大模型。