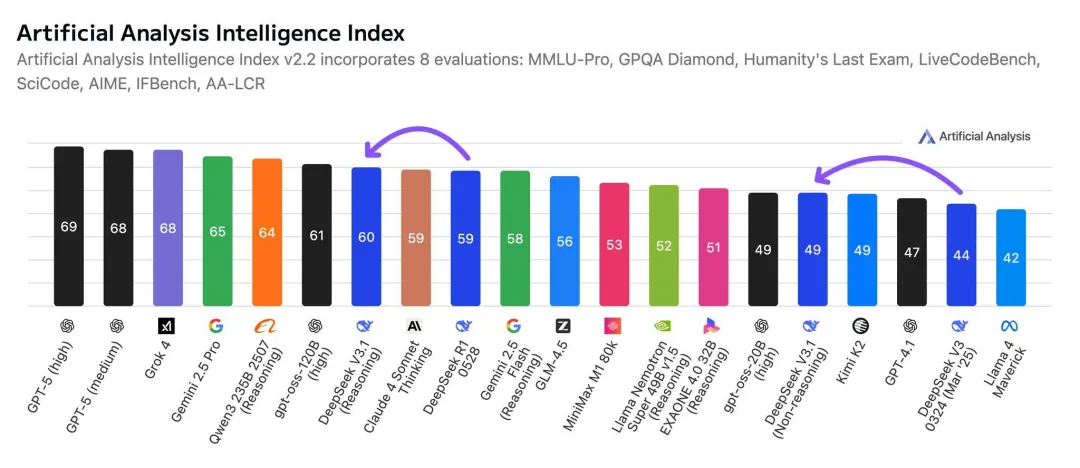

上周,DeepSeek-V3.1重磅更新发布,在混合推理、代码能力和agent类能力上相比上一个版本都有显著的提升,性能和表现直指近期更新的一众第一梯队模型。

来源:artificialanalysis.ai

除了模型本身,官方爆料:DeepSeek-V3.1采用的权重精度UE8M0 FP8是针对即将发布的下一代国产芯片的设计,引发更为广泛的关注。“UE8M0”“下一代国产芯片”,每个关键词都蕴藏巨大的惊喜和深意。接下来本文就从这几个关键词的角度,为大家带来深入解读。

首先要明确的一点是,所谓的UE8M0 FP8并不是这次爆料的一个全新设计,它所指的完全体是一种名为MXFP8的MX(Microscaling)微缩放格式。为了方便理解这一点,我们先回顾一下8位浮点数FP8的前世今生。

众所周知,计算机采用二进制对数据进行存储和计算,具体而言对于有小数点和小数位的小数,采用由符号位+指数位+尾数位组成的一个完整二进制序列来表示。AI领域常见的浮点数类型有:32位单精度浮点数FP32、16位半精度浮点数FP16以及Google Brain设计的另一种半精度浮点数BF16。

随着大模型的尺寸逐步提升,显存、带宽以及算力的瓶颈也持续加剧。为了进一步减少训练开销并提升训练效率,业界一直在朝着精度更低、存储更少的数据类型的应用发展。在原生支持FP8类型的Nvidia Hopper架构GPU推出后,从BF16进一步压缩到FP8进行训练也成为了可能,并首次由DeepSeek V3验证了其超大规模模型训练的有效性。

与半精度浮点数类似,FP8也有两种不同的实现,分别为4位指数位+3位尾数位的E4M3,以及5位指数位+2位尾数位的E5M2。

由于FP8的表示范围远比BF16窄,为了避免数值溢出对训练带来的破坏,需要一个缩放因子与FP8权重相乘以扩大表示范围。一般的FP8方案会为一个完整的FP8张量维护一个FP32缩放因子,好处是额外开销较少,但代价是量化粒度粗糙。

为了改进这一点,2023年OCP组织提出了名为MX的微缩放格式标准,规范了使用低精度数值和缩放因子的不同方法,其中就有MXFP8标准。这是一种以FP8为数据格式,每32个数值共享一个E8M0格式的缩放因子的方法,其中E8M0是一种8位全部用作指数位的新数据类型,由于没有符号位只表示正数,一些资料也写作UE8M0(unsigned E8M0)。它的动态范围与FP32一致,并且实际上只表示2的幂,所以在用缩放因子对数据进行复原时,处理器只需要移动一下指数位,不需要浮点乘法、规格化或舍入逻辑,从而缩短了耗时。

所以UE8M0 FP8实际上指的是使用UE8M0缩放因子的MXFP8格式。虽然MXFP8这一格式是Nvidia当前Blackwell架构GPU才支持的新特性,但是在去年底DeepSeek就已经以不同的方式,在Hopper架构GPU上完成了V3模型的MXFP8训练。其创新之处在于提出了混合策略的细粒度FP8量化:

- 对激活值,每1×128个FP8数值看作一组,共享一个缩放因子。

- 对权重值,每128×128个FP8数值看作一组,共享一个缩放因子。

这一实现即兼容了Hopper架构的FP8 kernel,确保了稳定性,也为类似Blackwell MXFP8的方案做好了准备。

而在推理方面,DeepSeek也在持续进行针对FP8的改进。在V3时期,所使用的缩放因子的格式仍是传统FP8方案中的FP32。在R1时期DeepSeek开源了其独家的FP8 kernel——DeepGEMM,并在社区支持下,实现了UE8M0缩放因子的方案。在最近的V3.1更新中,DeepSeek也考虑到了原有框架和对普通用户的兼容性,采取了用非指数位全部为0的FP32模拟UE8M0的方式开源。

读到这里大家应该明白了,这次爆料的核心是,即将发布的下一代国产AI芯片将会原生支持类似MXFP8格式的计算,进一步缩小与国外芯片的差距。关于到底是哪一家国产厂商,坊间有不少猜测但尚未有定论。综合目前公开的信息,国产算力阵营的主流厂商均已把支持FP8纳入路线图——预计下半年到明年会陆续面世出货,大概率都会给出官方实现或配套库支持,为模型落地扫清最后一道门槛。

面对国产化芯片的蓬勃发展趋势,优刻得也早早开始布局。通过持续加大研发投入,从底层架构优化到上层应用适配,对国产GPU展开全方位探索,致力于构建自主可控的AI产业生态,为国产芯片的广泛应用开辟新路径。依托自有的算力云平台,优刻得已经与沐曦、壁仞、昇腾、天数智芯等主流国产芯片厂商展开深度合作,推出了全面适配国产GPU芯片的云服务方案,持续提升国产算力在AI应用中的使用效率。

在模型服务端,优刻得也在积极探索FP8模型的创新应用,在AI模型服务平台UModelVerse持续带来功能和性能上的进化,为企业提供从模型微调、训练、评估到部署的全生命周期解决方案。UModelVerse配备的vLLM推理框架在优刻得技术团队的调优下,具备适配FP8推理的能力,让企业无需投入精力于底层资源建设和复杂的推理环境配置,将更多精力集中在业务逻辑和智能化升级上,以推动业务的智能化转型。