科技云报道原创。

“我们需要更大的GPU”!

3月19日凌晨,一年一度的“AI风向标”重磅会议——GTC 2024如期而至。

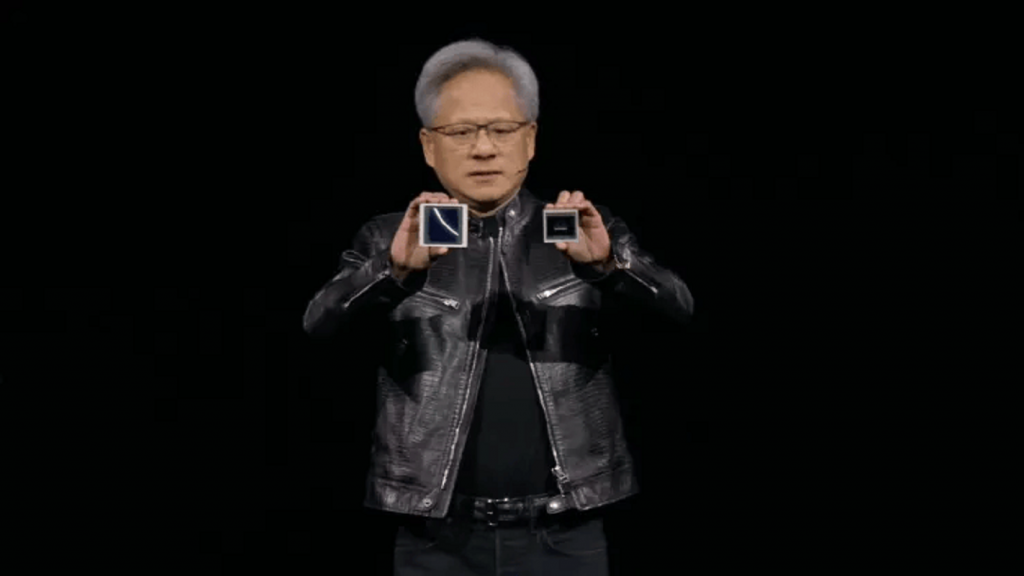

英伟达CEO黄仁勋在大会上发布了包括新一代加速计算平台NVIDIA Blackwell、Project GR00T人形机器人基础模型、Omniverse Cloud API、NVIDIA DRIVE Thor集中式车载计算平台等在内的一系列突破性科技成果。

其中,NVIDIA Blackwell作为英伟达的“王炸”力作,再次将AI芯片的技术标准推向了新的高度。

紧接着,NVIDIA和亚马逊云科技宣布了双方的扩展合作,Blackwell将很快登陆亚马逊云科技,并与亚马逊云科技引以为傲的网络连接、高级虚拟化和超大规模集群等领先技术结合,为数万亿参数规模的大模型推理工作负载带来巨大的性能飞跃。

万亿级参数规模正处在当前全球顶级大模型的实际参数区间,也许用户很快就能在各种生成式AI应用中体验到新硬件带来的提升。

“王炸”AI芯片诞生

训练万亿参数级别的大模型,需要多大规模的算力?

在GTC现场,黄仁勋首先算了一道数学题。以OpenAI最先进的1.8万亿参数大模型为例,该模型需要几万亿的Token进行训练。

万亿参数与数万亿的Token相乘,就是训练OpenAI最先进大模型所需的计算规模。黄仁勋估算,如果用一颗petaflop(每秒钟进行1千万亿次运算)量级的GPU进行运算,需要1000年的时间才能完成。

在Transformer发明后,大模型的规模正在以惊人的速度扩展,平均每6个月就会翻倍,这意味着万亿级别参数并不是大模型的上限。

在这种趋势下,黄仁勋相信,生成式AI的迭代和发展,需要更大的GPU、更快的GPU互连技术、更强大的超级计算机内部连接技术,以及更庞大的超级计算机巨型系统。

一直以来,NVIDIA推出的GPU一般是两种架构,其中面向游戏的GeForce RTX系列GPU是Ada Lovelace架构,面向AI、大数据等应用的专业级显卡是Hopper架构。风靡世界的H100就是基于Hopper架构。

虽然Hopper已经能够满足大部分商用市场的需求,但黄仁勋认为这样还不够:“我们需要更大的GPU,更需要将GPU堆叠在一起。”

于是,同时用以上两种架构类型的产品Blackwell诞生了。Blackwell是英伟达祭出的第六代芯片架构。这块小小的GPU,集成了2080亿个晶体管,拥有着超强的算力,也颠覆了此前所有的产品。

据黄仁勋透露,英伟达为该芯片的研发投入了100亿美元。这一新架构以加州大学伯克利分校数学家David Harold Blackwell命名。他专门研究博弈论和统计学,也是第一位入选美国国家科学院的黑人学者。

Blackwell在单芯片训练方面的FP8性能是其上一代架构的2.5倍,在推理方面的 FP4 性能是其上一代架构的5倍。它具有第五代NVLink互连,速度是Hopper的两倍,并且可扩展至576个GPU。

所以,Blackwell不是一个芯片,而是一个平台。

NVIDIA GB200 Grace Blackwell超级芯片通过900GB/s超低功耗的片间互联,将两个NVIDIA B200 Tensor Core GPU与NVIDIA Grace CPU相连。

其巨大的性能升级,能为人工智能公司提供20 petaflops或每秒2万亿次计算的AI性能,相较于H100,大语言模型性能提升30倍,同时能耗只有1/25。

不难看出,Blackwell平台如此卓越的性能提升,是为了下一代生成式AI做准备。而从OpenAI最近发布的Sora和已经开始研发更强大、更复杂的GPT-5模型也能看出,生成式AI的下一步是多模态和视频,也就意味着更大规模的训练。Blackwell带来了更多可能性。

如今,从谷歌的无边搜索引擎,到亚马逊的云顶天堂,再到特斯拉的智能驾驶,各大科技巨头正纷纷加入NVIDIA的Blackwell阵营,开启了一场令人兴奋的AI加速计算盛宴。

亚马逊、谷歌、戴尔、Meta、微软、OpenAI、Oracle、特斯拉等行业翘楚都在争先恐后地布局,准备在AI新时代大展身手。

难掩战略焦虑

受益于去年以来生成式AI的火爆,2月21日盘后,英伟达公布的最新一季度财报再次打破市场预期。财报显示,2024财年,英伟达总营收达609亿美元,同比增长125.85%;净利润为297.6亿美元,同比增长超581%;调整后每股盈利为12.96美元,同比增长288%。此次已经是英伟达实现连续四个季度的盈利超出市场预期。

英伟达的业绩加速实则反映了全球科技公司对于AI算力需求的激增。随着Sora等应用的横空出世,世人看到了大模型落地的巨大潜力。

生成式 AI很有可能进入“军备竞赛”阶段,与之伴随的是科技公司对芯片的需求也会持续提升。

Counterpoint Research的数据显示,2023年,英伟达的营收将飙升至303亿美元,比2022年的163亿美元增长86%,跃升为2023年全球第三大半导体厂商。

富国银行则预计,英伟达2024年将会在数据中心市场获得高达457亿美元的营收,或创下历史新高。

不过,创造历史的英伟达并非高枕无忧。英伟达在AI计算的“垄断”的现状并不让所有人都满意,竞争对手在竭力打破英伟达的统治地位,客户也需要第二个AI芯片供应源。

尽管英伟达的GPU有很多优点,不过它在用于AI时它可能耗电量太高且编程复杂。从创业公司到其他芯片制造商和科技巨头,英伟达的竞争对手层出不穷。

近期,OpenAI CEO奥尔特曼正在与中东阿布扎比G42基金、日本软银集团等全球投资者筹集超过80亿美元资金,成立一家全新AI 芯片公司,目标是利用资金建立一个工厂网络来制造芯片,直接对标英伟达。

2月17日,业内人士透露,日本投资界巨头软银集团创始人孙正义正在寻求筹集最高达1000亿美元的资金,打造一家规模庞大的合资芯片公司,这家公司能够与芯片设计部门Arm形成互补。

过去,AMD一直在进行其新一代AI战略规划,包括并购和部门重组等,但生成式AI的横空出世导致该公司产品阵容进一步扩充:去年12月发布的MI300芯片专门面向复杂的AI大模型,配置了1530亿个晶体管、192GB的内存、每秒5.3TB的内存带宽,分别是英伟达最强AI芯片H100的大约2倍、2.4倍和1.6倍。

亚马逊云科技也在自研芯片领域进行持续投入,以提升客户云上工作负载性价比。亚马逊云科技很早就面向AI领域推出了Trainium训练芯片和Inferentia推理芯片两个系列,并不断更新迭代。

去年底推出Trainium2能够通过云中扩展和网络互联提供65exaflops的AI算力,数周时间即可完成3千亿参数的大语言模型的训练。这些AI芯片已被使用在包括Anthropic等生成式AI领域的头部企业当中。

这些大厂不约而同地砸下重金,选择自研AI芯片,透露出谁都不想将科技的话语权和主导权交到芯片大厂的手中,只有处于“AI食物链”顶端,才有可能掌握通向未来的钥匙。

研发为底,生态为径

黄仁勋曾在很多地方有过这样的表示:英伟达不是在销售芯片,而是在销售解决问题的能力。

在这种产业生态共建的理念驱动下,英伟达围绕GPU打造了一个涵盖硬件、软件及开发工具在内的生态系统。

例如,英伟达在自动驾驶领域的投资成果显著,其Drive PX系列平台以及后来推出的Drive AGX Orin系统级芯片,成为了众多汽车制造商实现高级驾驶辅助系统(ADAS)和自动驾驶的关键部件,这是底层技术创新与实际应用场景深度融合的成功案例。

面对行业竞争,英伟达希望发挥整体的生态协作力量,共同为产业服务,为市场服务。

英伟达与云计算“一哥”亚马逊云科技的合作同样成果不凡,从第一个GPU云实例到现在的Blackwell平台解决方案,双方的合作已经超过13年。客户很快就能在亚马逊云科技上使用基于NVIDIA GB200 Grace Blackwell Superchip和B100 Tensor Core GPUs的基础设施。

英伟达的超强算力芯片系统与亚马逊云科技强大的Elastic Fabric Adapte(EFA)网络连接能力、高级虚拟化(Amazon Nitro System)和超大规模集群(Amazon EC2 UltraClusters)等领先技术的结合,使得客户能够更快更大规模且更安全地在云上构建和运行数万亿参数的大语言模型。

在大模型研发领域,万亿级参数规模此前还算是一道门槛。根据公开的报道,去年年中发布的GPT4的模型参数是1.8万亿,由8个220B模型组成;前不久发布的Claude3模型没有公布参数规模,而马斯克最新开源的Grok大模型参数是3140亿参数规模。

双方此次合作,有望在加速万亿级别大语言模型的研发方面,为生成式AI领域的突破提供新的可能。

英伟达自身的AI团队专门在亚马逊云科技上构建了Project Ceiba项目,以帮助其推动未来生成式AI的创新。

Ceiba项目首次亮相是在2023年11月底亚马逊云科技2023 re:Invent全球大会上,这是当时英伟达与亚马逊云科技合作建造的世界上最快的AI超级计算之一,当时的计算性能为65 exaflops。

随着Blackwell平台加入Ceiba项目,为其带来了7倍于原先的计算性能,现在,该AI超级计算机将能够处理高达414 exaflops的AI计算量。

新的Ceiba项目拥有20,736颗B200 GPU的超级计算机,采用新型NVIDIA GB200 NVL72系统构建,该系统利用第五代NVLink技术连接10,368颗NVIDIA Grace CPU。

系统还通过亚马逊云科技的第四代EFA网络进行扩展,为每个Superchip提供高达800 Gbps的低延迟、高带宽网络吞吐量。

此外,亚马逊云科技还计划提供配备基于新的英伟达B100 GPU的Amazn EC2实例,并能够在Amazon EC2 UltraClusters中进行大规模部署。

此次合作被黄仁勋抱以更多期待:“人工智能正在以前所未有的速度推动突破,导致新的应用、商业模式和跨行业的创新。

英伟达与亚马逊云科技的合作正在加速新的生成式AI能力的发展,并为客户提供前所未有的计算能力,以推动可能性的边界。”

如此多的行业,如此繁复的创新,英伟达正与其合作伙伴构建起越来越强大的AI生态,共同引领生成式AI的新纪元。用黄仁勋的话说,当计算机图形学、物理学、人工智能交汇,便衍生出NVIDIA的灵魂。

【关于科技云报道】

专注于原创的企业级内容行家——科技云报道。成立于2015年,是前沿企业级IT领域Top10媒体。获工信部权威认可,可信云、全球云计算大会官方指定传播媒体之一。深入原创报道云计算、大数据、人工智能、区块链等领域。